AI en ethiek betekent dat je kunstmatige intelligentie zo ontwerpt, inzet en controleert dat systemen eerlijk, veilig, transparant en verantwoord werken. In de praktijk gaat het om het beperken van bias in AI, het beschermen van privacy, het uitleggen van uitkomsten en het organiseren van menselijke controle. Verantwoord gebruik van AI is nodig om schade, discriminatie, fouten en verlies van vertrouwen te voorkomen. Tegelijk helpt het organisaties om beter te voldoen aan AI regelgeving en om betrouwbare systemen duurzaam op te schalen. In dit artikel lees je wat AI-ethiek inhoudt, welke risico’s het belangrijkst zijn en hoe je dit praktisch toepast.

- AI en ethiek draait om eerlijkheid, transparantie, privacy, veiligheid en verantwoordelijkheid.

- Belangrijke risico’s zijn discriminatie, privacyproblemen, onduidelijke besluitvorming en misbruik.

- De EU AI Act maakt goed AI governance en documentatie steeds belangrijker.

- Een ethische aanpak vraagt om testen, monitoren, duidelijke rollen en menselijke controle.

- Met een praktische AI impact assessment kun je risico’s vroeg herkennen en beperken.

Wat betekent AI en ethiek?

AI en ethiek gaat over de normen en waarden rond het ontwerpen, trainen, inzetten en controleren van AI-systemen. De centrale vraag is eenvoudig: hoe gebruik je AI op een manier die mensen helpt, zonder onnodige schade, uitsluiting of misbruik?

Veel organisaties kijken eerst naar snelheid, efficiëntie en innovatie. Dat is begrijpelijk. Maar een technisch goed werkend model is nog niet automatisch een verantwoord model. Ethische AI kijkt daarom verder dan prestaties alleen. Het gaat ook over impact op mensen, rechten, vertrouwen en samenleving.

Belangrijkste principes van ethische AI

Transparantie

Gebruikers moeten weten dat ze met AI te maken hebben. Ook moet zo duidelijk mogelijk zijn hoe een systeem tot een uitkomst komt. Meer transparantie in AI helpt om keuzes beter te begrijpen en maakt systemen beter toetsbaar.

Eerlijkheid en biasbeperking

AI mag groepen mensen niet structureel benadelen. Bias ontstaat vaak door scheve data, gebrekkige aannames of te weinig controle. Daarom is het beperken van bias in AI een kernonderdeel van verantwoord gebruik van AI.

Privacy

AI gebruikt vaak veel data. Daarom moet je zorgvuldig omgaan met persoonsgegevens en gevoelige informatie. Privacy en AI zijn in de praktijk sterk met elkaar verbonden, zeker bij systemen die gedrag analyseren of voorspellen.

Verantwoordelijkheid

Er moet altijd duidelijk zijn wie verantwoordelijk is voor keuzes, toezicht en correctie. AI ondersteunt, maar vervangt menselijke verantwoordelijkheid niet.

Veiligheid

Betrouwbare AI moet goed getest zijn en beschermd zijn tegen fouten, manipulatie en misbruik.

Menselijke controle

Bij beslissingen met grote impact moet een mens kunnen ingrijpen, beoordelen of bijsturen. Dit wordt ook wel human in the loop genoemd.

Waarom is ethische AI belangrijk?

De impact van AI kan groot zijn. Een fout in een gewone tool is vervelend. Een fout in een AI-systeem kan leiden tot discriminatie, reputatieschade, juridische problemen of verlies van vertrouwen.

Dat geldt extra sterk bij toepassingen zoals recruitment, kredietbeoordeling, medische ondersteuning, fraudedetectie en klantenservice. In zulke situaties is verantwoord gebruik van AI geen luxe, maar een voorwaarde.

Wie AI slim wil inzetten, moet daarom niet alleen investeren in technologie, maar ook in beleid, processen en toezicht. Dat sluit goed aan op bredere ontwikkelingen rond wat AI is en hoe het wordt toegepast.

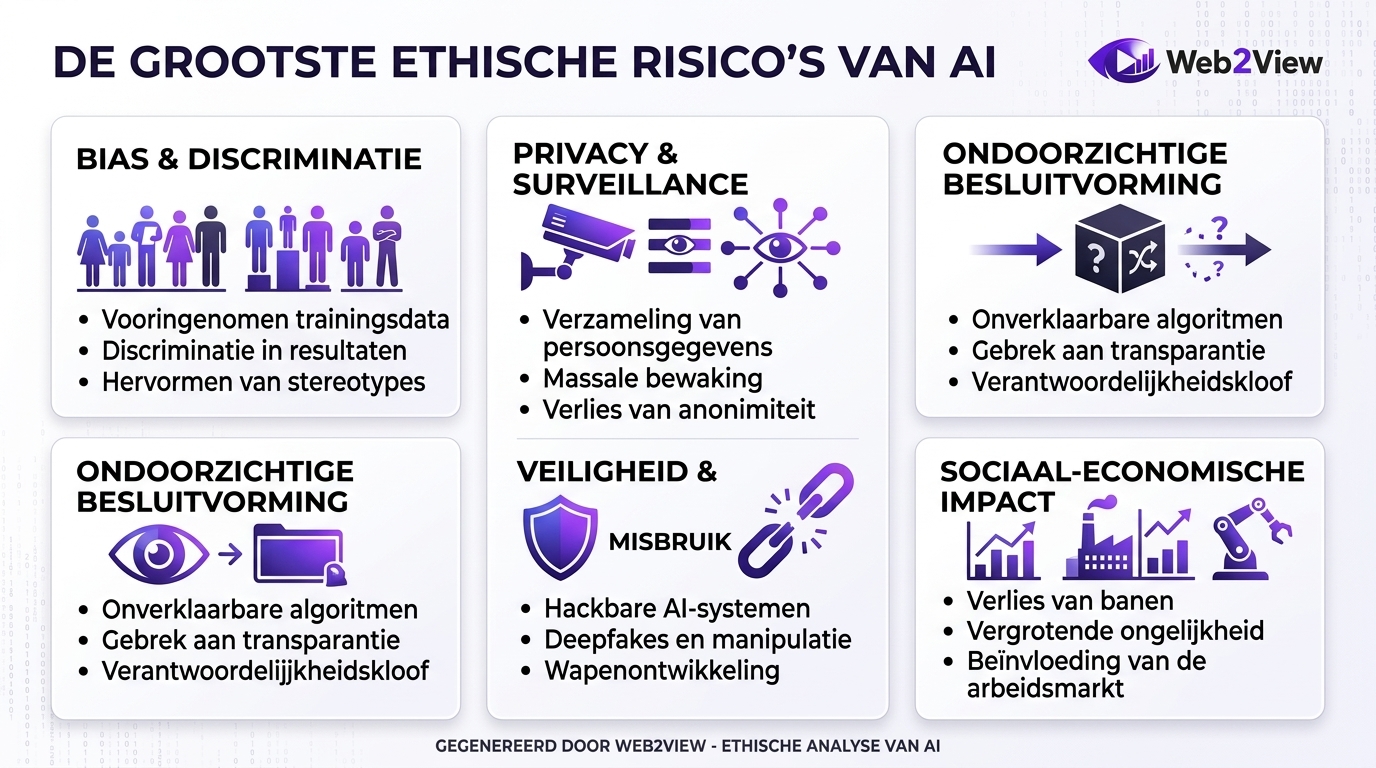

De grootste ethische risico’s van AI

De discussie over AI en ethiek is allesbehalve theoretisch. De risico’s zijn concreet en komen in de praktijk vaak voor.

Bias en discriminatie

Bias in AI is een van de bekendste risico’s. Een model leert van historische data. Als die data al vooroordelen of scheve patronen bevat, neemt het model die vaak over.

Daardoor kunnen bepaalde groepen slechter beoordeeld worden, zonder dat iemand dat bewust wil. Denk aan sollicitatiesystemen die bepaalde profielen voortrekken. Of aan kredietmodellen die onbedoeld nadelig uitpakken voor mensen uit specifieke wijken of inkomensgroepen.

Bias voorkomen vraagt om representatieve datasets, testen per doelgroep en periodieke audits. Organisaties die AI inzetten voor automatisering doen er goed aan ook kritisch te kijken naar processen automatiseren met AI vanuit risico, controle en toezicht.

Privacy en surveillance

AI heeft vaak veel data nodig. Daardoor is privacy een belangrijk onderdeel van AI-ethiek. Zeker als systemen gedrag analyseren, profielen opbouwen of gevoelige gegevens verwerken.

Voorbeelden zijn gezichtsherkenning, medewerkerstracking en systemen die persoonlijke voorkeuren voorspellen zonder duidelijke toestemming. Hier raken ethische aspecten van AI direct aan privacy en AI regelgeving.

Ondoorzichtige besluitvorming

Veel AI-systemen werken deels als een black box. Je ziet de uitkomst, maar niet altijd de reden erachter. Dat is problematisch als een beslissing grote gevolgen heeft.

Mensen willen begrijpen waarom ze zijn afgewezen, lager zijn gerankt of een bepaald advies krijgen. Daarom is uitlegbaarheid essentieel. Explainability maakt betrouwbare AI beter toetsbaar en begrijpelijker.

Veiligheid en misbruik

AI-systemen kunnen fouten maken. Ze kunnen ook bewust verkeerd worden ingezet. Denk aan deepfakes, geautomatiseerde fraude, misleidende content of foutieve output in kritieke processen.

Veiligheid moet daarom vanaf het begin onderdeel zijn van ontwerp, ontwikkeling en beheer. Niet pas achteraf.

Sociaal-economische impact

AI verandert werk. Sommige taken verdwijnen. Andere taken veranderen. Er ontstaan ook nieuwe rollen.

Dat biedt kansen, maar kan ook zorgen geven. Goede AI-ethiek kijkt daarom niet alleen naar efficiëntie, maar ook naar opleiding, begeleiding en eerlijke inzet van technologie binnen teams.

AI regelgeving en internationale kaders

AI en ethiek gaan niet alleen over normen en waarden. Het onderwerp is steeds sterker verbonden met wetgeving, toezicht en compliance.

De EU AI Act in het kort

De EU AI Act is een belangrijk Europees kader voor AI regelgeving. Deze wet deelt AI-systemen in op basis van risico. Hoe hoger het risico, hoe strenger de verplichtingen.

Voor hoog-risicosystemen gelden extra eisen rond documentatie, datakwaliteit, menselijke controle, monitoring en transparantie. Sommige toepassingen worden zelfs verboden, zoals bepaalde vormen van manipulatie of onrechtmatige surveillance.

Voor organisaties betekent dit dat AI governance niet optioneel is. Je moet weten welke systemen je gebruikt, wat ze doen, welke risico’s erbij horen en hoe je toezicht organiseert.

Andere relevante richtlijnen

Naast de EU AI Act zijn er meerdere internationale richtlijnen die richting geven aan verantwoord gebruik van AI. Denk aan de UNESCO Recommendation on the Ethics of Artificial Intelligence, de OECD AI Principles en het NIST AI Risk Management Framework.

Deze kaders leggen vaak dezelfde nadruk op mensenrechten, veiligheid, uitlegbaarheid en verantwoordelijkheid. Ze helpen organisaties om een interne standaard op te bouwen voor betrouwbare AI.

Van theorie naar praktijk: hoe pas je AI en ethiek toe?

Veel organisaties begrijpen dat AI-ethiek belangrijk is. De uitdaging zit meestal in de uitvoering. Daarom helpt een praktisch stappenplan.

Stap 1: Voer een AI impact assessment uit

Breng eerst in kaart wat het AI-systeem doet, wie geraakt wordt en welke risico’s er zijn. Stel vragen als: welke data gebruiken we, welke beslissingen ondersteunt het model en wat gebeurt er als de uitkomst fout is?

Een goede AI impact assessment maakt risico’s vroeg zichtbaar. Zo voorkom je dat problemen pas na livegang aan het licht komen.

Stap 2: Regel data governance zorgvuldig

De kwaliteit van AI begint bij data. Controleer daarom waar data vandaan komt, of die representatief is en of gevoelige kenmerken indirect toch invloed hebben op de uitkomst.

Leg ook vast wie toegang heeft tot data, hoe lang gegevens worden bewaard en hoe wijzigingen worden gedocumenteerd. Goede AI governance begint vaak met volwassen dataprocessen.

Wie dit goed wil organiseren, heeft baat bij heldere structuur en documentatie. Dat zie je ook terug in onderwerpen als website structuur, waar logische opbouw en duidelijke ordening bijdragen aan betrouwbaarheid en beheer.

Stap 3: Ontwikkel met fairness, privacy en uitlegbaarheid

Kijk tijdens de ontwikkeling niet alleen naar nauwkeurigheid. Test ook op fairness tussen groepen, kies waar mogelijk voor uitlegbare modellen en gebruik privacyvriendelijke technieken.

Denk aan dataminimalisatie, anonimisering, federated learning en differential privacy. Niet elke techniek past overal, maar het uitgangspunt blijft hetzelfde: gebruik niet meer data dan nodig is.

Stap 4: Test, monitor en stuur bij

Een AI-model is nooit echt klaar. Na implementatie moet je blijven meten. Verandert de data? Ontstaat er nieuwe bias? Wordt het systeem gebruikt zoals bedoeld? Weten medewerkers wat ze moeten doen bij twijfel of fouten?

Doorlopende monitoring is essentieel. Zeker voor organisaties die AI breder inzetten in commerciële processen of AI marketing verder willen opschalen.

AI governance: wie is verantwoordelijk?

Een veelvoorkomend probleem bij AI is onduidelijk eigenaarschap. De techniek ligt bij development, privacy bij legal en de toepassing bij de business. Daardoor kunnen risico’s tussen afdelingen verdwijnen.

Goede AI governance maakt rollen en taken expliciet.

Belangrijke rollen binnen AI governance

- Product owner: Verantwoordelijk voor doel, scope en gebruik van het systeem.

- Data scientist of developer: Verantwoordelijk voor modelkeuzes, validatie en technische documentatie.

- Compliance of privacy officer: Verantwoordelijk voor toetsing aan regels, privacy en interne kaders.

- Management: Verantwoordelijk voor beleid, prioriteiten en toezicht.

- Ethics review board: Optioneel, maar waardevol bij toepassingen met grote impact.

Wie AI serieus neemt, organiseert dus niet alleen tooling, maar ook besluitvorming, escalatie en controle.

Tools en methoden voor betrouwbare AI

AI en ethiek vraagt niet alleen om goede intenties. Je hebt ook praktische tools nodig om risico’s zichtbaar te maken en te verkleinen.

Tools voor bias en fairness

Er zijn verschillende open source tools waarmee je fairness kunt testen. Voorbeelden zijn IBM AI Fairness 360 en Fairlearn. Deze helpen om verschillen tussen groepen te meten en modellen beter te evalueren.

Tools voor explainability

Voor uitlegbaarheid worden vaak SHAP en LIME gebruikt. Daarmee kun je inzichtelijk maken welke factoren invloed hadden op een voorspelling of aanbeveling.

Frameworks en standaarden

Bekende frameworks zijn het NIST AI Risk Management Framework en IEEE-richtlijnen voor ethische technologie. Deze bieden houvast voor organisaties die AI governance professioneler willen inrichten.

Werk je al met meerdere digitale systemen, dan is het slim om ethische toetsing te verbinden aan je bredere stack. Daarbij kan ook een overzicht van beste AI tools helpen om bewuster te kiezen.

Praktijkvoorbeelden van ethische AI

Praktijkvoorbeelden maken AI-ethiek concreet. Ze laten zien wat goed werkt en waar het vaak misgaat.

Case 1: Positieve toepassing met duidelijke controle

Een organisatie gebruikt AI om klantenservicevragen te categoriseren en sneller door te sturen. Er worden geen automatische eindbeslissingen genomen. Medewerkers houden controle, gevoelige data wordt beperkt gebruikt en het model wordt regelmatig getest.

Dit werkt goed omdat AI ondersteunt in plaats van overneemt. Er is transparantie richting gebruikers en er is altijd menselijke correctie mogelijk.

Case 2: Discriminatie door scheve trainingsdata

Een bedrijf gebruikt AI om sollicitaties voor te selecteren. Na verloop van tijd blijkt dat bepaalde kandidaten structureel lager scoren. De oorzaak zit in historische data die al scheef was opgebouwd.

De les is duidelijk: bias in AI ontstaat vaak ongemerkt. Zonder audits, representatieve data en menselijke controle kan een systeem bestaande ongelijkheid versterken.

Case 3: Gebrek aan uitleg zorgt voor wantrouwen

Een financiële organisatie gebruikt AI voor risico-inschattingen. Klanten krijgen een uitkomst, maar geen begrijpelijke uitleg. Daardoor ontstaat frustratie, zelfs als het model technisch redelijk presteert.

Dit laat zien dat transparantie niet alleen technisch is. Het is ook een communicatievraagstuk. Dat raakt aan vertrouwen en gebruikservaring.

Checklist voor verantwoord gebruik van AI

Wil je snel beoordelen of een AI-toepassing verantwoord is ingericht? Gebruik dan deze checklist.

Korte checklist

- Is het doel van het AI-systeem duidelijk omschreven?

- Is bekend welke groepen door het systeem geraakt worden?

- Is de herkomst van de data gedocumenteerd?

- Is de dataset gecontroleerd op vertekening?

- Wordt alleen noodzakelijke data gebruikt?

- Is privacy vanaf het begin meegenomen?

- Is er menselijke controle bij belangrijke beslissingen?

- Kun je de uitkomsten uitleggen aan gebruikers?

- Is vastgelegd wie verantwoordelijk is?

- Wordt het model periodiek getest en gemonitord?

- Is er een proces voor klachten of correctie?

- Sluit het systeem aan op wetgeving en interne richtlijnen?

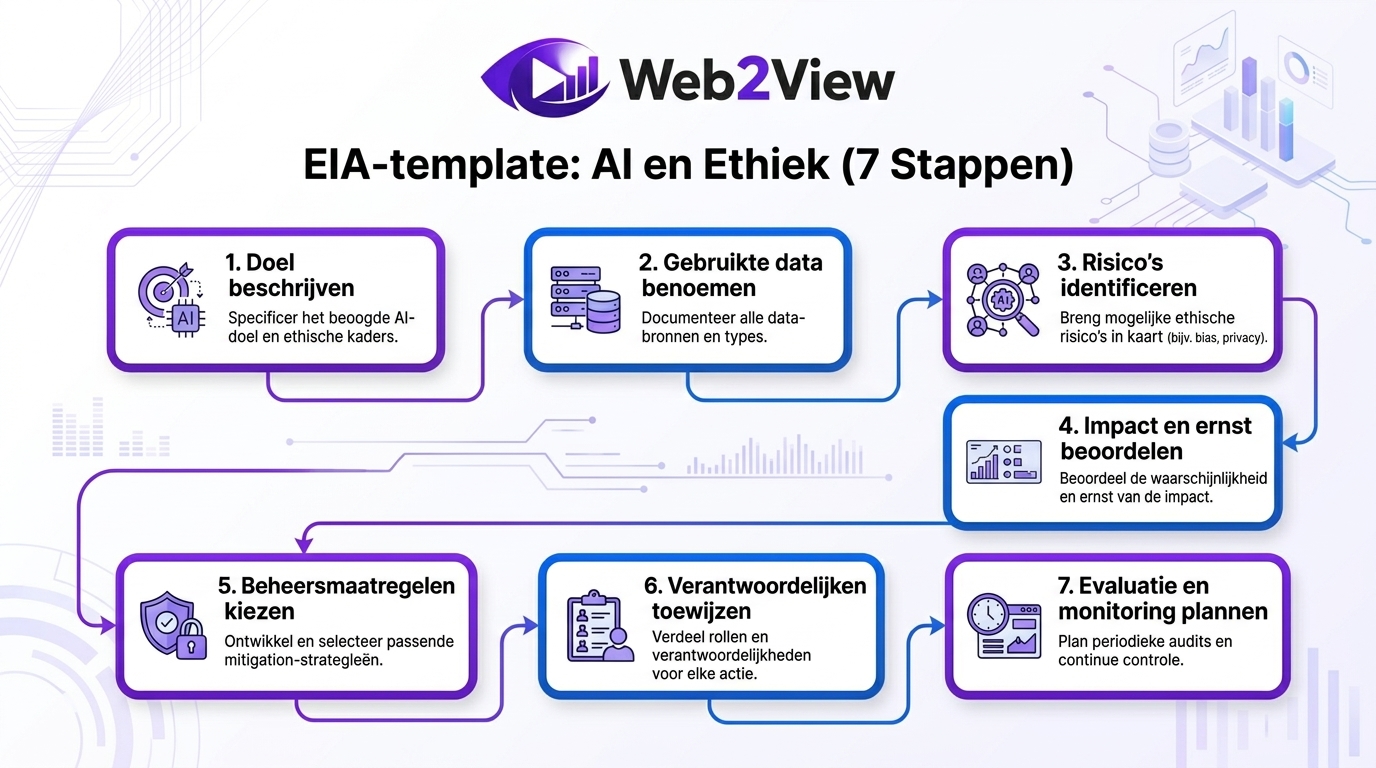

Eenvoudige EIA-template in 7 stappen

- Beschrijf het doel van de AI-toepassing.

- Benoem welke data wordt gebruikt.

- Identificeer mogelijke risico’s voor mensen en groepen.

- Beoordeel impact, kans en ernst.

- Kies beheersmaatregelen.

- Wijs verantwoordelijken toe.

- Plan evaluatie en monitoring.

Veelgestelde vragen over AI en ethiek

AI-ethiek is het geheel van normen en principes voor het verantwoord ontwikkelen en gebruiken van kunstmatige intelligentie. Het gaat onder meer over eerlijkheid, privacy, transparantie, veiligheid en menselijke controle.

Omdat AI grote impact kan hebben op mensen, rechten en besluitvorming. Zonder ethische kaders kunnen systemen leiden tot bias, discriminatie, onduidelijkheid of verlies van vertrouwen.

Belangrijke risico’s zijn bias, privacyproblemen, ondoorzichtige besluitvorming, veiligheidsissues, misbruik en negatieve effecten op werk en samenleving.

Door representatieve data te gebruiken, modellen per doelgroep te testen, audits uit te voeren en menselijke controle in te bouwen. Bias voorkomen vraagt om blijvende monitoring.

De EU AI Act legt vooral regels op voor AI-systemen met een hoger risico. Denk aan eisen rond documentatie, transparantie, datakwaliteit, monitoring en menselijke controle.

AI-ethiek gaat over wat verantwoord en wenselijk is. AI-regelgeving gaat over wat wettelijk verplicht is. In de praktijk heb je beide nodig voor betrouwbaar AI-gebruik.

Dat betekent dat een mens toezicht houdt op AI en kan ingrijpen bij belangrijke beslissingen, twijfelgevallen of fouten.

Conclusie

AI en ethiek is geen rem op innovatie. Het is juist de basis voor duurzame, betrouwbare en schaalbare innovatie. Wie AI verantwoord inzet, kijkt niet alleen naar snelheid en resultaat, maar ook naar eerlijkheid, privacy, uitlegbaarheid en menselijke controle.

Organisaties die dit nu goed regelen, bouwen meer vertrouwen op en zijn beter voorbereid op nieuwe wetgeving en strengere verwachtingen. Begin daarom klein, maar begin wel. Maak risico’s zichtbaar, leg verantwoordelijkheden vast en toets AI structureel.

Wil je verder kijken dan de basis? Verdiep je dan ook in de toekomst van AI om strategisch vooruit te denken en verantwoorde keuzes te maken.

Zo wordt AI niet alleen slimmer, maar ook beter voor de mensen die ermee werken.